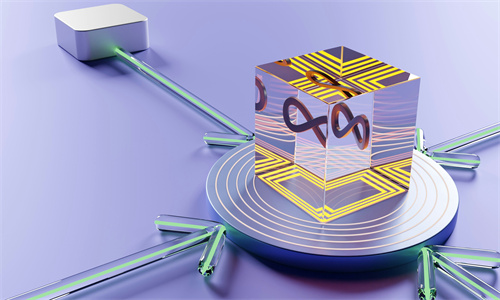

前馈式反向传播(Feedforward Backpropagation)是一种在神经网络中用于训练和调整网络权重的方法。它是深度学习领域中的一种基本算法,用于通过最小化预测误差来优化网络结构。

以下是前馈式反向传播的基本步骤:

1. 前馈过程:

输入数据通过网络的输入层进入。

每一层神经元的输出作为下一层的输入。

每个神经元使用激活函数(如Sigmoid、ReLU等)来处理输入数据。

最终,输出层产生预测结果。

2. 计算误差:

将预测结果与实际标签进行比较,计算损失函数(如均方误差、交叉熵等)。

损失函数反映了预测结果与实际结果之间的差异。

3. 反向传播:

从输出层开始,将误差信号反向传播到网络的每一层。

在每一层,计算每个神经元的梯度(即误差对权重的偏导数)。

梯度表示了权重调整的方向和幅度,以减少损失函数。

4. 权重更新:

使用梯度下降或其他优化算法(如Adam、RMSprop等)来更新网络权重。

权重更新公式通常为:新权重 = 旧权重 学习率 梯度。

5. 迭代优化:

重复上述步骤,直到满足预设的停止条件(如损失函数小于某个阈值、达到最大迭代次数等)。

前馈式反向传播的核心思想是通过不断调整网络权重,使网络能够更好地拟合训练数据。这种方法在图像识别、自然语言处理、语音识别等领域得到了广泛应用。